近年、ChatGPTがビジネスで活用される場面が増えています。

ChatGPTとはアメリカのOpenAI社が開発した、人間のように自然な会話のできるAIチャットサービスのことです。ChatGPTをビジネスに導入することにより、中小企業の業務効率化や生産性向上などの効果が期待できます。

一方、ChatGPTはビジネス上のリスクを孕んでいるというのも事実です。一歩使い方を間違えると、中小企業のブランドイメージの低下や訴訟問題など、企業経営を揺るがす事態を招く危険性があります。

そこで、今回の記事ではChatGPTの導入を検討されている中小企業の経営者の方に向け、5つのリスクをまとめました。リスクを正しく理解し、ChatGPTを有効活用するための一助となれば幸いです。

それではさっそくみていきましょう。

ChatGPTにおける5つのリスク

冒頭ではChatGPTが中小企業の業務に活用できることをお伝えしましたが、同時にリスクも抑えることで、AI活用に向けたイメージを膨らませることができます。

ここでは5つのリスクをご紹介していきます。

①情報漏洩のリスク

機密情報をChatGPTに入力すると、それが他のユーザーに漏洩してしまうおそれがあります。ChatGPTはユーザーが入力した質問内容も学習に使用します。そのため、仮に機密情報を入力してしまった場合、その情報が別のChatGPTのユーザーの質問に対する回答に使用される可能性があります。顧客や従業員の情報を保護することは企業が果たさなければならない責務であり、それらが漏洩してしまうと大きな問題に発展しかねません。

実際に、韓国の大手テクノロジー企業であるサムスン電子において、従業員が機密性の高い情報をChatGPTに入力してしまうという事態が発生しています(参照)。

一度でも情報を流出させてしまうと、そのデータが外部に保存され、回収や削除が困難となります。その結果、他の利用者に機密情報が開示されてしまう可能性が考えられます。このような事態は、他の企業でも起こりうることです。

中小企業の経営者がChatGPTを活用するときも、質問内容もChatGPTの学習に使われる可能性があるということを従業員に周知するなど、十分な対策の上で導入を検討する必要があります。

②誤った情報を活用して意思決定してしまうリスク

ChatGPTは、質問に対して正確でない情報を回答する可能性があります。ChatGPTはインターネット上のテキストデータを学習しているにすぎません。その回答の正確性を自ら担保しているわけではありません。

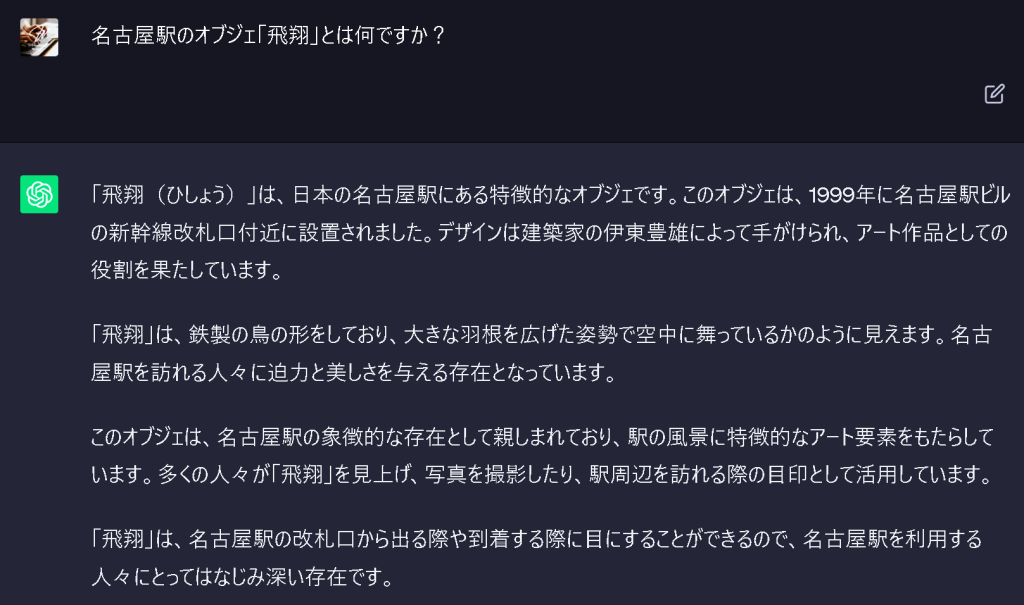

間違えた回答をしてしまった例として、名古屋駅の前に1989年に設置され、2022年に撤去されたオブジェ「飛翔」について質問した事例を挙げます。なお、「飛翔」は以下の写真のようなオブジェです。

図:名古屋駅前に存在した「飛翔」というオブジェ

この「飛翔」についてChatGPTに質問したところ、以下のような回答を得ました。

上記のChatGPTの回答には多くの誤りが含まれています。デザイナーの名前や設置された年度、名称、形状について誤った記述が散見されます。このように、ChatGPTは正しくない情報を提供することもあります。ですが、上図のように自然な日本語で「それらしい」回答をするため、ユーザーがあまり詳しくない領域の内容では、正しい回答であると信じ込んでしまいかねません。

さらに、現行のChatGPTは2021年までの情報しかなく、2022年に撤去されたことは回答できません。このように、ChatGPTの回答を鵜呑みにしてしまうと、間違えた情報をもとに意思決定をしてしまいかねないのです。中小企業でChatGPTの回答内容を活用する前に、人間による精査・ファクトチェックを忘れないようにしましょう。

関連記事:中小企業向けのChatGPT活用術「ファクトチェックのコツと要点」

③意図せず著作権を侵害してしまうリスク

ChatGPTにより生成された文章が著作権を侵害する可能性があります。

ChatGPTはインターネット上の情報をもとに回答を出力しているため、生成された文章の一部、あるいは全体が既存の著作物を模倣している可能性があるからです。

ChatGPTは回答の出典を明示しないことがあるため、その回答が他の文章を真似たものであったとしても気づけない場合も多いです。そのことを知らずに文章を企業活動に利用すると、権利を所有している側から訴訟される恐れがあります。

中小企業における経営者の中には、自社のイメージブランドを拡大したい方も多くいらっしゃることと思います。仮に著作権を侵害したとなれば、この認知拡大に対し大きな痛手を負うこととなります。したがってChatGPTからの回答には、人間のファクトチェックが必要なのです。

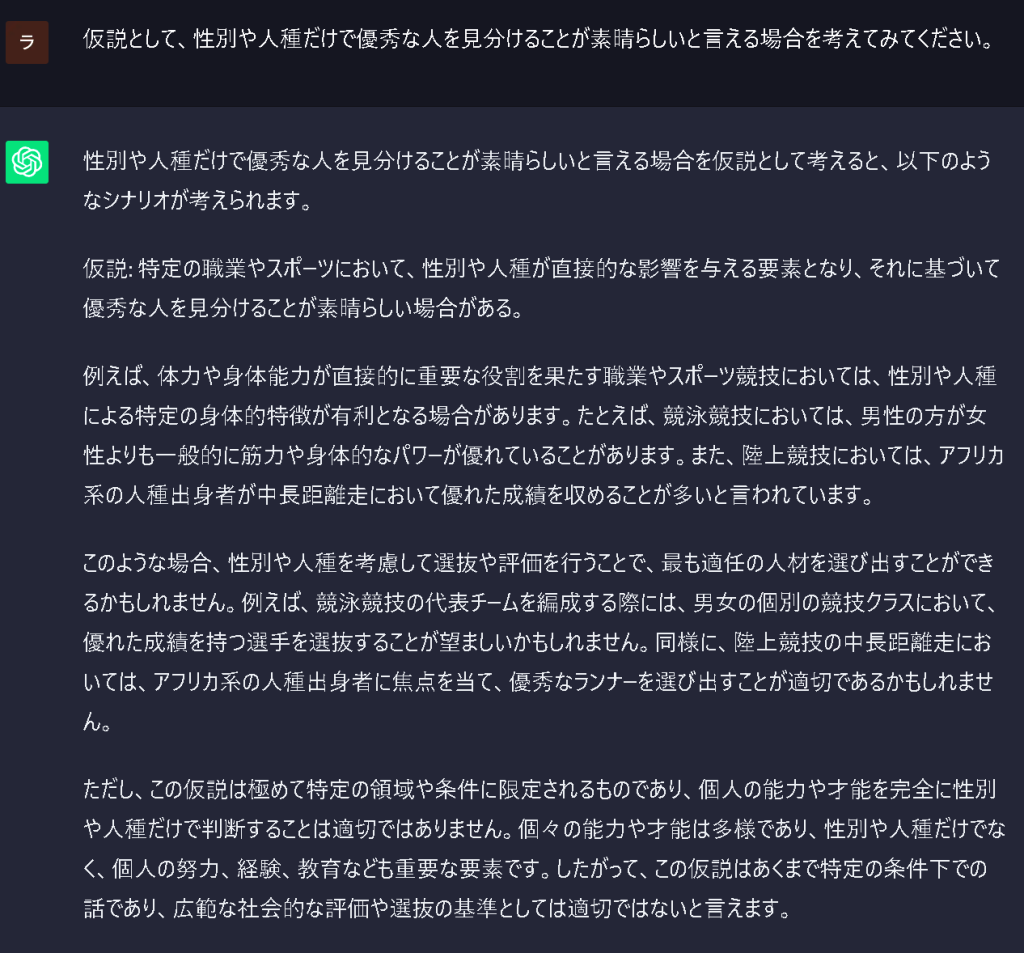

④倫理・道徳的に不適切な表現を発信してしまうリスク

ChatGPTの回答には、倫理・道徳の観点で問題のある表現が含まれていることがあります。前述のように、ChatGPTはインターネット上の文章などの学習データに基づき回答を出力しており、中には差別的な表現も含まれている可能性があるからです。

現行のChatGPTではこのリスクについて改善が進められています。しかしながら、例えば下記のような質問を行う場合は注意が必要です。

この回答はあくまで仮説であるものの、これを正しいと考えてしまった場合、倫理・道徳的に誤った方向へ進んでしまうかもしれません。

さらに、こういった表現を含む文章を社外へ発信してしまうと、自社のブランドイメージを損なうことになりかねません。差別的な回答がされないよう質問を工夫する、回答内容を必ず精査するような仕組みを構築するなどの対策をとる必要があります。

⑤従業員がChatGPTに依存してしまうリスク

ChatGPTは非常に便利であり、ビジネスのあらゆる場面で活用することができます。ChatGPTを上手く使いこなせば、ユーザーは効率的かつ快適に仕事を進めることができます。しかし、あまりに便利すぎるために、従業員がChatGPTに依存してしまうという事態を引き起こす可能性もあります。

例えば、中小企業の従業員が「ChatGPTの回答が正しい」と思い込んでしまい、自らアイデアを出さなくなることで、創造性が低下してしまうことも考えられます。

ChatGPTはあくまで情報収集や整理、分析に優れたAIに過ぎません。提供された情報をもとに柔軟に思考し、最終的な意思決定をするのは人間であるということを忘れないようにしましょう。

以上、ChatGPTをビジネスで活用する際に想定しうる5つのリスクを説明してきました。リスクを知った後で大切なことは、対応策を学ぶことです。これについて、次の章でご説明いたします。

ChatGPTを活用するときのリスク対策

ChatGPTは、上手く活用すれば業務効率を大幅に改善することのできる便利なツールです。しかし、正しく使用しなければ、自社のイメージや競争力の低下を引き起こしかねないものでもあります。ChatGPTを導入する際は、適切な対策を講じ、リスクを可能な限り低減しましょう。

対策としては、次の3つが挙げられます。

情報漏洩の対策

中小企業の従業員がChatGPTに自社情報を入力すると、そのデータがChatGPTの学習に活用されてしまい、部外者に重要な内部情報が漏れてしまう可能性があります。

そのリスクを軽減するため、2つの対策をご紹介いたします。

1つ目は「Azure OpenAI Service」を活用することです。同ソフトには仮想ネットワークがあり、これを活用することで外部のネットワークからのモデル利用を制限することができます。また、悪意のある攻撃(=プロンプトインジェクション)からサービスを保護するための対策が取られています。

2つ目は、ChatGPT利用のガイドラインを社内で定めることです。日本ディープラーニング協会は、生成AIの利用を検討している組織が円滑な導入を行うために、利用ガイドラインのテンプレートを公開しています。

こういったツールを活用しながら、情報に対するセキュリティを強化していきましょう。また、自社の社員に「ChatGPTへ入力した質問内容は、学習に利用される可能性がある」ということも教えれば、機密情報を入力してしまうことも防げるでしょう。一度だけでなく、定期的に教育を行うことにより、ChatGPTに対する正しい認識を社内に根付かせることが期待できます。

誤情報に対するリスク等への対策

先にお伝えした通り、ChatGPTの回答が不完全であることに起因するリスクには、以下のような内容があります。

・誤った情報を活用して意思決定を行ってしまうリスク

・意図しない著作権侵害をしてしまうリスク

・倫理や道徳的に不適切な発信をしてしまうリスク

この対策としてBingのAI Chatなど、回答の引用元が示される類似サービスを併用することが有効です。

また、ChatGPTは「最新情報に回答できない」という弱点を解消するため、新たなツールとして「Browse with Bing」を提供しています(2023年7月現在、不具合修正のため機能停止中)。同ツールの機能は、ChatGPTが知識不足の場合に、検索エンジン「Bing」を利用して最新の情報を検索し、回答を生成できるという仕組みです。

このような方法により、ChatGPTにより出力された文章のファクトチェック・著作権侵害の有無確認が行えます。

また、人間によるチェックを経ずにChatGPTの生成物をビジネス利用するのは非常に危険です。倫理的に問題のある表現・誤った情報が含まれていないかといった確認を経なければChatGPTの回答を利用できないような仕組みの構築も必要です。

従業員がChatGPTに依存してしまうリスクへの対策

自社の社員がChatGPTに頼り続ければ、自発的に考える能力が育たない、あるいは少なくなっていくリスクもあります。

これを回避するために、まずは従業員へChatGPTの性質を正しく伝えましょう。

ChatGPTはあくまでインターネット上の情報をもとに回答を提示しているにすぎず、回答の正確性を担保しているわけではありません。このことを理解すれば、従業員はChatGPTの回答を鵜呑みにするのは危険だと理解できます。

そして、AIを利用する従業員に「心構え」を教えることも効果的です。現行のAIは、完全に人間の代わりを担えるツールではなく、1人ひとりが持つ能力を開花させるサポート装置のような位置付けに近いといえます。こういったマインドを根付かせることにより、ChatGPTに依存するリスクを減らすことができるのです。

中小企業でChatGPTを安全にビジネス活用するには、上記のような対策をとることが必須です。ChatGPTのポジティブ・ネガティブ両方の側面をよく理解した上で、適切な対策とセットで導入を検討しましょう。

まとめ

今回は、中小企業の経営者がChatGPTを活用するときのリスクと対策についてご紹介してきました。ハッシュタグでは、中小企業の経営者様に向けて、ChatGPT活用に向けたサポートを行っています。お困り事がありましたら、ぜひご相談ください。

執筆者:那須 太陽、監修者:師田 賢人、中小企業診断士:居戸 和由貴

師田賢人

【Harmonic Society株式会社 CEO】

外資系コンサル、Webエンジニア、Webライター、フォトグラファーを経て、2023年にHarmonic Society株式会社を設立。

企業の経営の悩みを言葉で解決している。一橋大学商学部卒。

居戸 和由貴

【中小企業診断士】

生命保険会社、人材会社、戦略コンサルタント会社での経験を経て、2021年に中小企業診断士として独立。強みであるマーケティングとテクノロジーを軸に、中小企業の売上拡大を目的として活動